一、痛点切入:为什么需要大模型智能体

要理解大模型智能体的价值,先看看传统AI助手的局限。

传统实现方式通常是一个大语言模型(LLM),用户输入问题,模型输出答案,交互止步于文本响应-14。这种“一问一答”的模式在简单场景下够用,但面对复杂任务时问题频出:

被动响应:用户问什么才答什么,无法主动规划执行;

单步限制:无法拆解多步骤任务,如“写报告”只能逐段输出而非全流程执行;

工具缺失:只能输出文本,无法调用引擎、数据库、代码解释器等外部工具。

从工程角度看,传统实现存在几个关键缺陷:

① 耦合高。 业务逻辑与模型调用强耦合,换一个LLM可能就要改大量代码。② 扩展性差。 每增加一个外部工具都需要定制化接入,难以复用。③ 代码冗余。 围绕LLM的封装代码在多个项目中重复出现。④ 上下文断裂。 长对话中容易丢失关键信息,导致回答偏离用户意图。

正是这些痛点的存在,催生了新一代AI宏助手的诞生。

二、核心概念讲解:大模型智能体

什么是大模型智能体

大模型智能体(Large Language Model Agent,简称LLM Agent) 是以大语言模型为“大脑”,具备自主感知环境、规划分解任务、调用外部工具、执行行动并反馈修正的AI系统-14。

拆解核心关键词

“自主” :能主动拆解高层指令为可执行的子任务序列,无需逐条引导。

“工具调用” :能调用引擎、数据库、API、代码执行器等扩展能力边界。

“闭环行动” :形成“感知→规划→行动→反馈→修正”的完整决策循环。

“持久记忆” :可以跨会话保持上下文贯通,像一个真正“在工作”的角色。

生活化类比

智能体就像一个会思考、会动手的数字员工:你告诉它“帮我策划一次团建”,它会自动拆解任务——查场地、比价格、订时间、发通知、收反馈,最后给你一份完整的方案。而传统AI助手只会回答“好的,团建可以考虑去xx地点”,然后就结束了。

作用与价值

大模型智能体的核心价值在于将LLM的“认知能力”转化为“执行能力”,实现从“你问它答”到“你说它做”的范式跃迁-14。

三、关联概念讲解:大模型 vs AI助手 vs 智能体

要真正理解智能体,必须厘清它与大模型、AI助手的区别。

大语言模型

大语言模型(Large Language Model, LLM) 是基于Transformer架构,通过海量文本数据预训练,拥有数十亿乃至万亿参数的人工智能模型-54。典型代表有GPT系列、DeepSeek、文心一言等。LLM的本质是一个“超级语言引擎”——给定输入,输出文本,被动响应、没有记忆、不会主动行动-14。

AI助手

AI助手(AI Assistant) 是在大模型外包裹了一层交互界面与记忆管理,能进行多轮对话,但本质仍是“人问、AI答”的被动交互模式-14。

三者的关系与差异

| 对比维度 | 大语言模型 | AI助手 | 大模型智能体 |

|---|---|---|---|

| 本质 | 语言引擎 | 交互入口 | 执行系统 |

| 交互模式 | 被动响应 | 被动对话 | 自主规划+执行 |

| 工具调用 | 不支持 | 有限 | 广泛支持 |

| 任务能力 | 单步生成 | 多轮对话 | 多步分解+闭环执行 |

一句话概括:大模型是“大脑”,AI助手是“会说话的大脑”,智能体是一个“会行动、会协作、会学习的数字员工”-14。

四、代码示例:极简智能体实现

下面用约40行Python代码实现一个极简的AI宏助手,帮助读者直观理解其运行机制。

import json from typing import Dict, List 定义可用的工具函数 def search_web(query: str) -> str: """模拟网络""" return f"结果: 关于'{query}',找到相关资讯" def send_email(recipient: str, content: str) -> str: """模拟发送邮件""" return f"邮件已发送至 {recipient}" 工具注册表 TOOLS = { "search_web": search_web, "send_email": send_email, } 极简智能体主循环 def agent_loop(user_query: str, max_steps: int = 3) -> str: """ 智能体核心循环:思考 → 行动 → 观察 → 继续 """ print(f"用户: {user_query}") for step in range(max_steps): Step 1: 规划(此处用LLM做决策,简化为关键词匹配) if "" in user_query: action = "search_web" param = user_query.replace("", "").strip() elif "发送" in user_query and "邮件" in user_query: action = "send_email" param = "team@example.com" else: 无工具匹配时,直接用LLM生成回复 return f"回复: {user_query},我需要更多信息" Step 2: 执行工具调用 result = TOOLS[action](param) print(f"智能体[步骤{step+1}]: 调用 {action} -> {result}") Step 3: 观察结果并决定是否继续 实际场景中,这里会将result返回给LLM进行下一步决策 return f"任务完成: {result}" return "达到最大步数,任务终止" 测试 if __name__ == "__main__": print("\n" + "="50) result = agent_loop("AI宏助手最新进展") print(f"最终结果: {result}")

代码关键点解析:

工具注册表:将所有可调用的外部函数集中管理,便于扩展。

决策循环:智能体的核心是“循环+工具调用”模式-。

行动执行:根据规划结果执行对应工具,并将结果反馈。

对比传统方式:传统实现需要人工编码调用逻辑、逐条判断用户意图,而智能体模式下,系统自主完成意图识别→工具匹配→执行→反馈的完整闭环,大幅降低开发成本和响应延迟。

五、底层原理:智能体如何“长出手脚”

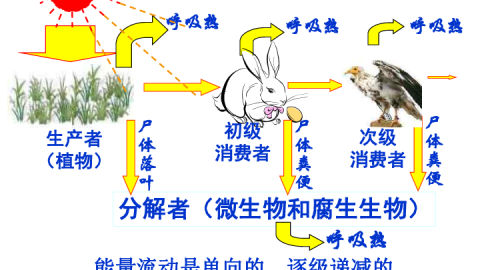

大模型智能体的底层能力依赖几个关键技术支撑:

1. Function Calling

Function Calling是让大模型具备“工具调用能力”的核心机制。模型在生成回复的同时,可以决定“我需要调用某个工具”,并输出结构化的调用参数,由外部系统执行后再将结果返回给模型。

2. Agent Loop

智能体本质是一个“while循环”:接收用户输入 → 模型思考并决定行动 → 执行工具 → 观察结果 → 模型根据结果决定下一步,重复直到任务完成-。

3. 记忆与上下文管理

智能体需要管理两类记忆:

短期记忆:当前会话内的交互历史,保证上下文连贯;

长期记忆:跨会话存储的用户偏好、项目经验等,实现自我进化-40。

4. 工具调用协议(如MCP)

MCP(Model Context Protocol,模型上下文协议)是由Anthropic提出的标准化协议,旨在统一AI与外部工具之间的交互方式,解决工具碎片化、高耦合与上下文丢失等问题-。通过MCP,不同厂商的LLM可以用同一种“语言”调用各类工具,极大提升了跨模型兼容性。

六、高频面试题与参考答案

问题1:LLM和Agent有什么区别?

参考答案:LLM(大语言模型)是被动的“大脑”,擅长理解和生成文本;Agent(智能体)在LLM基础上增加了“行动力”,具备自主规划、工具调用、记忆管理和闭环执行的完整能力。简单说,LLM负责“思考”,Agent负责“思考+行动”。

问题2:智能体的核心架构包含哪些模块?

参考答案:主要包括五个核心模块——①感知模块(理解用户输入与环境状态)、②规划模块(分解任务为可执行步骤)、③记忆模块(管理短期/长期上下文)、④工具模块(封装外部API和函数)、⑤执行模块(调用工具并处理反馈)。部分学术框架将其归纳为“感知→大脑→规划→行动→工具使用→协作”六层架构-。

问题3:什么是Agent Loop?

参考答案:Agent Loop是智能体运行的核心循环模式,基本流程为:用户输入 → 模型推理决策 → 执行工具/行动 → 观察结果 → 根据结果决定下一步 → 循环直至任务完成。这种“思考-行动-观察”的迭代机制是智能体区别于传统LLM的根本所在-。

问题4:如何解决智能体的“幻觉”问题?

参考答案:主要策略包括:①结合检索增强生成(RAG)引入实时知识库;②采用ReAct框架,强制交替“推理”与“行动”,通过行动反馈校准模型输出-50;③使用规范驱动开发(Spec-Driven Development),先生成文档与逻辑定义再生成代码-;④设置操作沙箱和日志审计-3。

问题5:Function Calling的工作原理是什么?

参考答案:Function Calling通过工具注册表预先定义可用函数的名称、参数类型和描述。模型在生成回复时,如果判断需要调用工具,会输出结构化的JSON参数而非直接生成文本;外部系统解析后执行对应函数,将结果返回给模型继续推理。这实现了LLM与外部世界的能力扩展。

七、结尾总结

核心知识点回顾

大模型智能体 = LLM(大脑) + 工具调用 + 记忆管理 + 闭环执行。

三层次关系:大模型是能力底座,AI助手是交互入口,智能体是任务执行形态-14。

核心机制:Agent Loop(循环决策)和Function Calling(工具调用)是智能体“长出手脚”的两大关键技术。

底层支撑:MCP协议统一工具调用标准,RAG解决知识时效性问题。

行业现状与易错点提示

2026年,全球超过65%的企业级代码已由AI辅助生成--,主流AI编程工具已从“代码补全”升级为“需求→设计→编码→测试→部署”全链路智能体-。开发者常见的误区是将AI助手和智能体混为一谈——记住:智能体的核心标志是“能否自主执行闭环任务” ,而非仅仅“能否对话”。

进阶预告

下一篇我们将深入讲解多智能体协同架构:如何让多个智能体像团队成员一样协作完成超复杂任务,包括A2A协议、Skill设计与多智能体编排模式,敬请期待。